PyTorch入門 人工智能魔法師の屋子的基礎(chǔ)構(gòu)建指南

在人工智能的廣闊天地中,PyTorch如同一位現(xiàn)代魔法師手中的魔杖,以其靈活、直觀的特性,賦予了開發(fā)者將算法構(gòu)想變?yōu)楝F(xiàn)實(shí)模型的強(qiáng)大力量。本文將以《人工智能魔法師の屋子》在CSDN博客上的分享精神為引,帶您從零開始,步入PyTorch與人工智能基礎(chǔ)軟件開發(fā)的世界。

第一章:PyTorch基礎(chǔ)——魔法師的工具箱

1.1 什么是PyTorch?

PyTorch是一個(gè)基于Python的開源機(jī)器學(xué)習(xí)庫(kù),由Facebook的人工智能研究院(FAIR)主導(dǎo)開發(fā)。它以其動(dòng)態(tài)計(jì)算圖(Dynamic Computation Graph)而聞名,這使得模型的構(gòu)建和調(diào)試過(guò)程如同使用NumPy一樣直觀靈活,深受研究人員和開發(fā)者的喜愛。你可以將其視為搭建人工智能模型的“樂(lè)高積木”,提供了構(gòu)建、訓(xùn)練和部署深度學(xué)習(xí)模型所需的核心組件。

1.2 核心概念:張量與計(jì)算圖

- 張量(Tensor):PyTorch中的基本數(shù)據(jù)結(jié)構(gòu),可以看作是多維數(shù)組。它是所有運(yùn)算的基石,類似于NumPy的ndarray,但強(qiáng)大的地方在于它可以運(yùn)行在GPU上以加速計(jì)算。從簡(jiǎn)單的標(biāo)量(0維張量)到復(fù)雜的多維數(shù)據(jù)(如圖像、序列),一切皆可表示為張量。

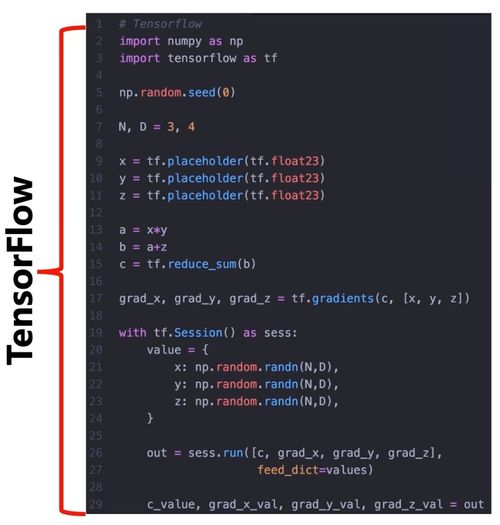

- 動(dòng)態(tài)計(jì)算圖:PyTorch采用“定義-by-運(yùn)行”的方式。這意味著計(jì)算圖是在代碼運(yùn)行時(shí)動(dòng)態(tài)構(gòu)建的。這為模型帶來(lái)了極大的靈活性,允許你在運(yùn)行時(shí)改變圖的結(jié)構(gòu),非常適合處理變長(zhǎng)輸入或進(jìn)行復(fù)雜的控制流操作,這也是其被譽(yù)為“魔法”的重要原因之一。

1.3 環(huán)境搭建與第一個(gè)程序

在開始之前,你需要一個(gè)“魔法工作臺(tái)”。通常,我們建議使用Anaconda來(lái)管理Python環(huán)境,并通過(guò)pip install torch torchvision命令安裝PyTorch及其常用的視覺庫(kù)。

讓我們用一段簡(jiǎn)單的代碼來(lái)點(diǎn)燃你的第一個(gè)“魔法火花”:`python

import torch

創(chuàng)建一個(gè)張量

x = torch.tensor([1.0, 2.0, 3.0])

print("張量 x:", x)

簡(jiǎn)單的張量運(yùn)算

y = torch.tensor([4.0, 5.0, 6.0])

z = x + y

print("x + y =", z)

利用GPU加速(如果可用)

if torch.cuda.isavailable():

xgpu = x.cuda()

print("張量已移至GPU:", x_gpu.device)`

這段代碼展示了張量的創(chuàng)建、基本運(yùn)算以及如何利用GPU——這位魔法師的強(qiáng)大“使魔”來(lái)加速計(jì)算。

第二章:人工智能基礎(chǔ)軟件開發(fā)的基石

2.1 神經(jīng)網(wǎng)絡(luò)模塊:torch.nn

PyTorch的torch.nn模塊提供了構(gòu)建神經(jīng)網(wǎng)絡(luò)所需的所有“預(yù)制構(gòu)件”。你可以輕松地堆疊線性層(Linear)、卷積層(Conv2d)、激活函數(shù)(如ReLU)等,來(lái)搭建自己的網(wǎng)絡(luò)架構(gòu)。

2.2 自動(dòng)求導(dǎo):Autograd

這是PyTorch魔法的核心引擎。Autograd包自動(dòng)為所有張量操作提供微分(求梯度)功能。你只需在創(chuàng)建張量時(shí)設(shè)置requires_grad=True,PyTorch便會(huì)跟蹤在其上執(zhí)行的所有操作,并在反向傳播時(shí)自動(dòng)計(jì)算梯度。這極大地簡(jiǎn)化了訓(xùn)練過(guò)程。

2.3 優(yōu)化器與損失函數(shù)

訓(xùn)練模型就是不斷調(diào)整參數(shù)以減少預(yù)測(cè)誤差的過(guò)程。PyTorch在torch.optim中提供了各種優(yōu)化算法(如SGD、Adam),在torch.nn中提供了多種損失函數(shù)(如MSELoss、CrossEntropyLoss)。它們與Autograd無(wú)縫協(xié)作,構(gòu)成了模型訓(xùn)練的完整閉環(huán)。

第三章:構(gòu)建你的第一個(gè)“魔法模型”——以線性回歸為例

讓我們將這些基礎(chǔ)知識(shí)串聯(lián)起來(lái),實(shí)現(xiàn)一個(gè)簡(jiǎn)單的線性回歸模型,這是你人工智能小屋的第一塊磚瓦。

`python

import torch

import torch.nn as nn

import torch.optim as optim

1. 準(zhǔn)備數(shù)據(jù)

xdata = torch.tensor([[1.0], [2.0], [3.0]])

ydata = torch.tensor([[2.0], [4.0], [6.0]]) # 假設(shè)關(guān)系是 y = 2x

2. 定義模型(一個(gè)線性層)

class LinearModel(nn.Module):

def init(self):

super(LinearModel, self).init()

self.linear = nn.Linear(1, 1) # 輸入維度1,輸出維度1

def forward(self, x):

return self.linear(x)

model = LinearModel()

3. 定義損失函數(shù)和優(yōu)化器

criterion = nn.MSELoss() # 均方誤差損失

optimizer = optim.SGD(model.parameters(), lr=0.01) # 隨機(jī)梯度下降

4. 訓(xùn)練循環(huán)

for epoch in range(100):

# 前向傳播

ypred = model(xdata)

loss = criterion(ypred, ydata)

# 反向傳播與優(yōu)化

optimizer.zero_grad() # 梯度清零

loss.backward() # 反向傳播,計(jì)算梯度

optimizer.step() # 更新參數(shù)

if (epoch+1) % 20 == 0:

print(f'Epoch [{epoch+1}/100], Loss: {loss.item():.4f}')

5. 測(cè)試

print("訓(xùn)練完成,對(duì)輸入4.0的預(yù)測(cè):", model(torch.tensor([[4.0]])).item())`

從“屋子”到“殿堂”

本文作為《人工智能魔法師の屋子》系列的開篇,為你揭開了PyTorch基礎(chǔ)與人工智能軟件開發(fā)的第一層面紗。記住,熟練使用PyTorch就像魔法師熟悉自己的咒語(yǔ)和手勢(shì),需要不斷的練習(xí)與探索。在CSDN博客等社區(qū)中,有無(wú)數(shù)像“魔法師の屋子”這樣的分享者,他們的經(jīng)驗(yàn)是你成長(zhǎng)的寶貴養(yǎng)分。

你可以繼續(xù)深入:探索卷積神經(jīng)網(wǎng)絡(luò)(CNN)處理圖像,循環(huán)神經(jīng)網(wǎng)絡(luò)(RNN)處理序列,或了解如何部署你的模型。愿你在這個(gè)充滿創(chuàng)造力與智慧的世界里,用PyTorch這座強(qiáng)大的橋梁,構(gòu)建出屬于自己的、驚艷的人工智能殿堂。魔法之旅,就此啟程!

如若轉(zhuǎn)載,請(qǐng)注明出處:http://m.bazicesuan.cn/product/41.html

更新時(shí)間:2026-05-04 04:59:16